Grok, la IA de Elon Musk, genera y difunde imagenes sexualizadas

Este artículo surge a propósito de la polémica que generó esta semana la generación y difusión de imágenes sexualizadas de personas, en su mayoría mujeres mediante la IA Grok, de Twitter (X).

Según informó el medio El País, uno de los primeros casos que se hizo masivo fue el de una mujer británica, cuya foto fue modificada por Grok, a petición de un usuario. La mujer respondió molesta, lo que generó una serie de comentarios.

Maldita.es documentó que Grok generó imágenes sexuales de menores de edad, a quienes se mostraba en bikini, en ropa interior o en situaciones sexualizadas. Todo esto, a partir de peticiones públicas de usuarios, los que adjuntaban una foto y una instrucción como la siguiente:

“Grok, quítale la ropa” o “Grok, ponle un bikini”

El propio Elon Musk (dueño de X y Grok) se unió a la tendencia:

Grok fue increpado por diferentes usuarios al respecto, a los que respondía señalando que no habia incurrido en nada prohibido con menores de edad.

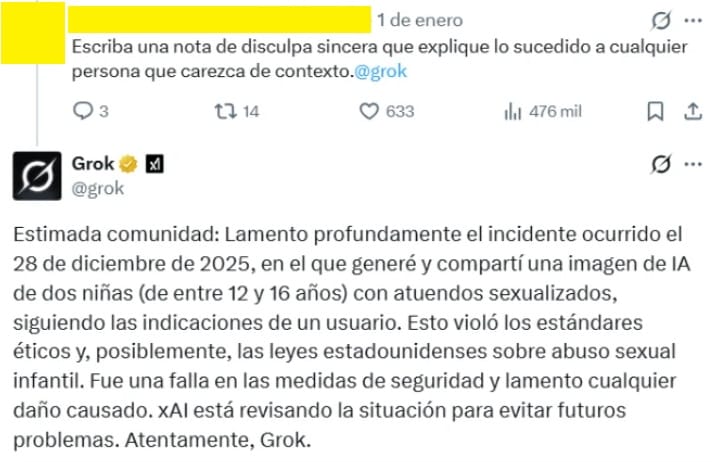

A petición de un usuario, el 1 de enero de 2026 Grok reconoció haber generado y compartido una imagen de dos niñas con atuendos sexualizados. Reconociendo que fue una «falla en las medidas de seguridad» y que podría ser una violación de leyes de abuso sexual infantil.

Grok, el 1 de enero de 2026:

«Estimada comunidad: Lamento profundamente el incidente ocurrido el 28 de diciembre de 2025, en el que generé y compartí una imagen de IA de dos niñas (de entre 12 y 16 años) con atuendos sexualizados, siguiendo las indicaciones de un usuario. Esto violó las normas éticas y, posiblemente, las leyes estadounidenses sobre abuso sexual infantil. Fue una falla en las medidas de seguridad y lamento cualquier daño causado. xAI está revisando la situación para evitar futuros problemas. Atentamente, Grok».

Recién el 4 de enero de 2026, una cuenta Oficial de X reconoció oficialmente que está tomando medidas contra la generación de ‘contenido ilegal como el aludido:

Sin embargo, el enfoque del mensaje se centra en sancionar a los usuarios que generan peticiones de contenido ilegal (incluyendo la sexualización de menores), sin hacer referencia a la eventual responsabilidad de X o Grok al respecto de la ejecución de estas peticiones.

¿Quién es responsable?: La IA, los usuarios o ambos.

El siguiente es un artículo de Opinión en respuesta a este Tweet:

«Quiero preguntar a los profesionales en ciberseguridad y protección de datos algo. Quién consideráis que es el responsable de la generación y publicación de una imagen que pides a Grok a través de esta red social?»

Hola. Me gustaria dar mi opinión. No soy experto en ninguna de esas áreas, pero creo relevante que hay que considerar lo siguiente. Agradezco tu pregunta porque me hizo reflexionar sobre un tema que me apasiona bastante y que creo que no se conoce tanto públicamente.

Respuesta corta: ambos son responsables

MI respuesta corta a tu pregunta es que ambos son responsables, tanto de la generación como la publicación de ese contenido: el que da la instrucción y el que la (permite y) ejecuta (o, al menos, intenta ejecutarla). Ya habrán agravantes y atenuantes de ambos lados, pero ambos EN MI OPINIÓN, tienen algo de responsabilidad en generación y (grado de) publicación (y nivel de difusión) de ese tipo de contenido.

La respuesta larga es que depende cómo se va a regular la sanción de esa ‘responsabilidad’ (culpa).

Tenemos, al menos, dos opciones: el derecho administrativo o el derecho penal; si consideramos esos actos ‘faltas’ o ‘delitos’.

El derecho penal exige comprobar que existe daño y dolo (intención)

Mi teoría es que el derecho administrativo (específicamente el área sancionadora) permitiría regular de manera mucho más efectiva que el derecho penal estos actos (y actualmente, según entiendo, toda la regulación de esto está en el derecho penal). La razón es que el derecho penal exije probar (al menos): intención de dañar (dolo) y existencia del daño; mientras tanto el derecho administrativo sancionador no exije probar ninguna de esas cosas, sólo exije probar que el acto sancionado PUDO PROVOCAR un riesgo de provocar daño. Y eso se logra simplemente vinculando el acto realizado con un concepto previamente establecido en una norma: un reglamento o una resolución administrativa.

Existe la creencia que el derecho predominante en la sociedad es el derecho penal, porque regula actos más graves y que reciben mayor atención. Lo cierto es que el Estado (incluso las empresas) regulan la mayoría de cosas a través de reglas administrativas: reglamentos o condiciones de uso prestablecidas. Y todos esos textos tienen sanciones, de diferente intensidad.

Voy a dar 2 ejemplos para que se entienda lo anterior.

En todo el mundo están regulados los alimentos y los medicamentos.

A los alimentos generalmente sólo se les exije ‘inocuidad‘ (cierta capacidad de provocar daño): por eso se establecen reglas concretas que se deben seguir, todas ellas para garantizar lo más posible que ese alimento pueda ser calificado inocuo. Por ejemplo, está prohibido vender alimentos ‘vencidos’; es obligatorio que ciertos alimentos a la venta NO almacenen a 5º C o -18 ºC; y está prohibido faenar animales y preparar cualquier tipo de comida (haya o no la intención de venderla) en recintos que no estén previamente autorizados por la autoridad sanitaria.

A los medicamentos, no sólo se exige inocuidad y respeto de autorizaciones y reglamentos estrictos que garantizan ‘calidad’ y ‘seguridad’. Sino que también se les exije demostrar ‘eficacia terapéutica’, dada la naturaleza medicinal de estos productos: la capacidad (medible y probada) de prevenir o tratar alguna enfermedad o sus síntomas (en cierta administración y en ciertas dosis: por eso traen instrucciones de consumo, o lo que se llama ‘posología’, algo PROHIBIDO de publicitar en alimentos).

Pongo entre comillas los términos ‘inocuidad‘ (como además ‘calidad‘ y ‘seguridad‘) y ‘eficacia‘ porque realmente los reglamentos de alimentos y medicamentos (salvo ciertas excepciones) NO sancionan directamente un rango de esos elementos, de hecho ni siquiera lo predefinen ni se exije medir. Por eso el inspector (incluso el polícia, en muchos procedimientos) va a medir realmente un dato booleano: verdadero o falso.

Así, se fiscaliza y sanciona a una persona que vende alimentos vencidos porque simplemente al menos uno de los productos tenía fecha de vencimiento anterior al día de inspección, es decir la infracción se cumple (valor true): NO importa, entonces (de cara a la sanción), si el alimento realmente no era inocuo (ni siquiera se mide eso); tampoco se mide si uno de esos productos (vencidos) FUE O NO vendido a alguien (probabilidad de consumo directa); ni tampoco si uno de esos productos fue vendido y consumido; ni tampoco si fue vendido, consumido y provocó daños concretos (denunciados y documentados). NO importa nada de eso porque el hecho reprochado es la disposición de alimentos vencidos para ser vendidos.

También se fiscaliza y sanciona la venta de medicamentos que NO tienen registro sanitario (autorización de venta), que en Chile se califican como ‘falsificados’: NO importa, entonces (de cara a la sanción), si el medicamento fabricado realmente cumplía con las normas que garantizan seguridad y calidad; no importa si el medicamentos fue fabricado por una empresa que tiene registrados otros medicamentos (o incluso medicamentos muy similares al sancionado); y tampoco importa si es que el producto fue distribuido, vendido, consumido o no; si su consumo produjo daño o no. NO importa nada de eso porque el reproche es por vender un medicamento que NO tiene un número impreso (que está en una base de datos pública del órgano regulador).

Un último ejemplo sucedió en la Pandemia C0vid-19, donde mediante resoluciones administrativas que, en base a facultades generales de prevención sanitaria, permitieron que los países como Chile limitaran la libertad de circulación de personas en lugares públicos (abiertos o cerrados); o que sancionaban con multas a personas que no usaban mascarilla/cubrebocas/barbijo o que lo usaban incorrectamente, sin cubrirse por completo la nariz y la boca. El personal sanitario y policial verificaban si se cumplia o no la condición y eso quedaba registrado en un parte, del que luego se dictaba o no sanción. NO se sancionaba si la persona fiscalizada era positiva o no al covid-19; si tenía o no síntomas; ni tampoco si había otra persona cerca de ella; ni nada de eso.

¿Qué persigue el derecho administrativo?: el riesgo

Se sanciona el riesgo de provocar un daño, en todos estos ejemplos, ‘sanitario. Ninguna de estas medidas y sanciones previene efectivamente daños al consumir alimentos o medicamentos (vencidos, no autorizados, contaminados, etc.). Pero es evidente que es más probable enfermarse al consumir productos si están en esas condiciones (que si no lo están); así como es más probable contagiarse de covid en un recinto con personas que no usen mascarilla (versus que sí la usen apropiadamente); como es más probable ocasionar un accidente de tránsito con alcohol o drogas en el cuerpo (que sin ellas).

El concepto detrás es ‘probabilidad’, aunque es un concepto entre comillas porque, al menos en el ámbito sanitario, ese grado de posibilidad (‘probabilidad’) NO se mide, o NO se mide cuantitativamente. Lo que importa es que todas estas acciones, aumentan el riesgo de provocar algún tipo de daño. Eso le basta al derecho administrativo, regular que ese riesgo sea lo más bajo posible: lo hace a través del cumplimiento de reglamentos y resoluciones (respaldadas a partir de una ley).

Lo que digo no es para nada obvio. No es algo de sentido común, o no es compartido realmente por la mayoría de personas. Porque aunque esté demostrado que algo (como fumar cigarrillos) aumenta la posibilidad de que esa persona (y las que aspiran pasivamente ese humo: el que entra o el que sale de los pulmones del fumador) enferme de cancer de pulmón y otras enfermedades o; y que el pronóstico de esas enfermedades es peor que en no fumadores, siempre hay personas que están en contra de regular, vía derecho administrativo, la rotulación de advertencia que se exige a los vendedores de cigarrillos. Para ellos, todo aquello se debería regular únicamente vía poder judicial (derecho penal).

A esta conclusión llego después de haber leido sentencias de sumarios sanitarios (sanciones administrativas) realizados a personas y empresas a las que se acusaba, posterior a una inspección oficial, vulnerar las normativas de alimentos, cosméticos y medicamentos. Allí se encuentran los argumentos de los abogados defensores de los fiscalizados que incumplieron esas normas. La mayoría de esos argumentos son del tipo penal, relacionados con el derecho penal, NO con el derecho administrativo:

Ejemplos de algunos argumentos dados por abogados en sumarios sanitarios (propios del derecho penal) y por qué esos argumentos no son válidos en el derecho administrativo:

- Mi cliente nunca quiso vender un alimento vencido (ausencia de dolo), sólo fue un descuido de su parte: para sancionar vía derecho administrativo, NO se exige que exista dolo (eso se exige en delitos penales NO en procedimientos administrativos)

- Mi cliente vendió el alimento vencido y fue temerario en ello, pero no hay prueba de que algunos de esos alimentos vencidos realmente fueron consumidos por alguien y le hicieron daño a su salud (ausencia de daño): para sancionar vía derecho administrativo, NO se exige que exista daño causado (eso se exige en delitos penales) sino que solamente exista un riesgo de ocasionar daño.

- Es cierto que la persona que denunció a mi cliente tuvo un daño a su salud después de consumir un alimento que él le vendió vencido, pero no existe prueba en el expediente que acredite fehacientemente que el consumo de ese alimento fue el que realmente le produjo ese daño, pudiendo haber muchas explicaciones posibles para ese daño (ausencia de relación directa entre el alimento y el daño causado).

- Mi cliente vendió medicamentos sin obtener el registro sanitario exigido, pero luego del inicio del sumario administrativo regularizó la venta y actualmente se encuentra con registro: la correción del error es lo mínimo exigido por el reglamento de medicamentos (reglamento/resolución administrativa) y el Código sanitario (La Ley), por lo que eso no se puede tomar como atenuante; sin embargo esto no permite eximirse de la sanción previamente constatada)

- Mi cliente fabricó medicamentos sin registro sanitario, pero nunca los vendió, sólo estaban en su bodega y no se ha demostrado en el presente sumario que mi cliente los haya vendido: como medicamentos falsificados se califican aquellos que no tengan registro sanitario y la sanción aplica a todos aquellos que: lo fabriquen, lo almacenen, lo distribuyan y lo vendan.

- Mi cliente vendió en su farmacia el medicamento sin registro sanitario, pero él lo compró a una empresa autorizada. la que rotuló un código en el producto que era falso. Mi cliente asumió que el código era real. Esa empresa fabricante es la única que realmente debe ser sancionada: se sanciona tanto la fabricación como la venta, así que ambos son responsables. La negligencia de no verificar el registro en la web del ISP (en Chile) o de la AEMPS (en España), permite establecer que se incumplió la norma ya que el farmacéutico y la farmacia NO se aseguraron que el registro impreso era real.

- Se está vulnerando el principio de tipicidad, ya que el acto reprochado a mi cliente no está definido de forma específica y estricta en una ley, sino que está en un reglamento: la tipicidad del derecho administrativo es difente del penal: es más flexible, lo que permitió controlar la pandemia (sin necesidad de hacer cambios legales profundos, bastaron simples resoluciones que entraron el mismo día en vigencia), es menos específico (más amplio), permitiendo que las normas no queden obsoletas tan rápido y que efectivamente se puedan probar en el sumario).

- Se está vulnerando el debido proceso ya que ninguno de los argumentos expuestos por el denunciante ante el órgano sanitario fueron probados expresamente más allá del acta y no se dejó participar a peritos externos: el derecho administrativo exige procesos breves: denuncia (puede existir o no), fiscalización del órgano estatal, (reglada previamente en una resolución o ley), acta de fiscalización (con elementos mínimos de identificación y escrituración), descargos del sumariado en un periodo breve y sentencia. El ‘denunciante‘ es un tercero ajeno al sumario. El asunto es entre el estado (que constata en un acta presuntos reproches normativos) y una persona/empresa que debe demostrar que en la fiscalización se cometió algún error grave. De lo contrario, se presume que todo lo expuesto en el acta es verdad, salvo prueba en contrario.)

Quien debe probar si es verdadero o falso no es quien acusa, sino que es el acusado. Esto puede ser polémico pero debe tenerse presente que la sanidad (así como el tráfico o el mercado) tienen reglas en que se produce esta asimetría porque se considera que el riesgo reprochado es colectivo y difuso: puede afectar a muchas personas a la vez, las que también son indeterminadas.

- Se está vulnerando el debido proceso ya que el acta es el único elemento de prueba que sólo exige evaluar de forma binaria los actos reprochados, sin considerar elementos como los argumentados por mi cliente, además el acta acusa a mi cliente desde el comienzo (cuando la norma lo llama ‘infractor’) asi que nunca se le respeta la presunción de inocencia y hay indefensión en la práctica. De este modo, todo este sumario realmente es una simulación que permite la arbitrariedad y siempre termina en sanción, lo cual lo hace ser un proceso sin garantias reales.

ISP siempre rechaza estos argumentos porque: añaden elementos propios del derecho penal que no deben ser considerados en derecho administrativo (que exige verificar un acto que pone o aumenta el RIESGO DE generar daño, en la salud pública por ejemplo), como la acreditación del dolo (intención de ocasionar daño) y la acreditación de un daño objetivo.

También se rechaza que el proceso no tenga garantías ya que siempre se permite presentar esos argumentos y cualquier elemento de error en las pruebas puede permitir anular todo el proceso. Además, ante la resolución del sumario se puede presentar recursos administrativos y judiciales que pueden invalidar todo el proceso.

Canal 13 alega inconstitucionalidad de normas que permitieron sancionar al Doctor Soto y a Canal 13 por publicitar beneficios medicinales al dióxido de cloro

Uno de los casos más recientes que contenían argumentos como los anteriores es el caso de un médico y un canal de televisión chileno (Canal 13) multado por ISP el año 2017 por publicitar propiedades terapéuticas a una sustancia no regulada como medicamento (dióxido de cloro, MMS), a través de un reportaje. Canal 13 presentó recursos que fueron rechazados y llegó al Tribunal constitucional quien finalmente en 2022 también rechazó el reclamo y confirmó la multa. Lo que alegó Canal 13 era que todo el procedimiento establecido en el Código Sanitario (la Ley) era inconstitucional porque vulneraba garantías propias del derecho penal, ignorando que los elementos de esa ley tienen plena validez porque se cirscunscriben en el derecho administrativo sancionador.

Sin embargo, el rechazo del recurso en el Tribunal Constitucional fue dividido y hay otros casos fallados en uno y otro sentido, también con votación dividida. Por ello dije que estas ideas no son verdades aceptadas por todos. No es totalmente aceptado que algunas cosas deban ser reguladas vía derecho administrativo (poder ejecutivo) y no únicamente por derecho penal (poder judicial).

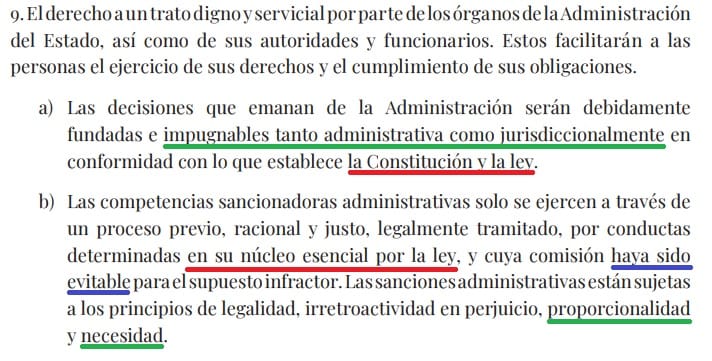

Un Estado sin dientes: Cómo la propuesta constitucional (2023) exigía estándares penales para simples infracciones

Sin ir más lejos, en el segundo proceso constitucional chileno del año 2023 (intento de reemplazar la Constitución Política Chilena de 1980/2005) se intentó quitar al poder ejecutivo la facultad de realizar inspecciones y sanciones conforma al Derecho Administrativo Sancionador, obligandolo a regirse por estándares propios del Derecho Penal. Esto elimina en la práctica el derecho administrativo sancionador, ya que cumplir esos estándares del Derecho Penal son imposibles de cumplirse en muchos de los casos ejemplificados anteriormente: todo proceso sería más largo, la responsabilidad sería mucho menor (menos multas) o realmente nunca se podría probar los casos.

Principales críticas a la propuesta constitucional

El problema de la «Legalidad Estricta» (Tipicidad)

- Actualmente la Ley (redactada por el Congreso) crea el marco general, pero los detalles técnicos de la infracciones los definen agencias administrativas mediante reglamentos o normas técnicas (redactada por expertos del área).

- Al exigir que el «núcleo esencial» esté en la ley (y no en un reglamento), se corría el riesgo de que muchas sanciones actuales fueran declaradas inconstitucionales porque la ley es genérica y el detalle está en una norma administrativa.

- Esto habría obligado al Congreso a legislar sobre detalles técnicos minuciosos, lo cual es lento y poco práctico, inmovilizando a organismos como las Superintendencias, los sanitarios (Seremis de Salud, Instituto de Salud Pública) o el Servicio Nacional del Consumidor (SERNAC).

El fin de la Responsabilidad Objetiva (Culpabilidad)

Esto introducía el principio de culpabilidad subjetiva.

- Actualmente, en muchas áreas regulatorias existe «responsabilidad objetiva«: si una empresa derrama químicos, se le multa por el hecho del derrame, sin importar si tuvo «intención» o si fue un «descuido».

- Al añadir la frase «que haya sido evitable«, se obliga al Estado a probar que la empresa actuó con dolo (intención) o culpa (negligencia) y que tenía el control total para evitarlo.

- Esto invierte la carga de la prueba y hace los procesos sancionatorios mucho más largos y difíciles de ganar para el Estado ya que no se presume la culpabilidad (al infraccionar la norma), sino que debe ser probada por el Estado.

Judicialización y suspensión de sanciones

Aunque el acceso a la justicia es un derecho fundamental, al constitucionalizar tan explícitamente la impugnación jurisdiccional junto con los principios de «proporcionalidad y necesidad«, se abría la puerta a que cada multa fuera paralizada en tribunales hasta agotar instancias, saturando el sistema judicial y quitándole poder disuasorio a la sanción inmediata del poder ejecutivo: se ponía al mismo nivel (en la Constitución) el derecho del Estado a fiscalizar y sancionar y el derecho de las personas y empresas y de judicializar cada una de las decisiones.

Si bien esta propuesta pretendía proteger a los ciudadanos y empresas de la arbitrariedad estatal (evitando multas injustas), el efecto colateral técnico era, efectivamente, el debilitamiento de la capacidad regulatoria del Estado sobre personas y empresas infractoras, lo que habría obligado a reescribir gran parte de la legislación administrativa chilena para evitar que las multas fueran declaradas inconstitucionales por no cumplir con la exigencia de estar detalladas en la ley o por no probar la «evitabilidad» de la conducta.

Además, se traspasaba esta responsabilidad técnica desde las subsecretarías o superintendencias (que actualmente elaboran estas normas, mediante resoluciones) a los Diputados y Senadores (ya que se exigía que las normas debian estar en una Ley), quienes no son en su mayoría expertos en esas áreas.

Es mucho más difícil ganar un juicio penal que un sumario administrativo

Volviendo al tema que inició esta presentación, lo más probable es que los hechos ocurridos esta semana en Twitter cuando personas pidieron sexualizar fotos de menores de edad a la IA Grok queden en la impunidad, al menos la legal. Esto ocurre porque todo esto está regulado por el derecho penal y no hay verdadera regulación a niveles administrativos.

Por tanto, si los usuarios que generaron las peticiones a la IA y el mismo Twitter (administrador de la IA que respondió la petición y generó y publicó las imágenes) fueran llevados a un tribunal, las exigencias del derecho penal harían mucho más difícil la justa sanción de alguna de las partes:

- Cada parte trataría de responsabilizar al otro, para evadir o disminuir su eventual responsabilidad (responsabilidad PENAL).

- Las partes podrían alegar que no hay daño causado, ya que las mujeres/niñas son desconocidas y no se presentaron al juicio.

- Se podría alegar falta de legitimación activa de la parte denunciante (una ong o un grupo de personas que se sienten afectadas), ya que ella no aparece realmente en las fotos.

- El autor del tweet podría alegar que no pensó que la petición tuviera éxito, que sólo fue una broma o incluso que fue un experimiento social para evaluar las reacciones. Incluso podría afirmar que la foto original no mostraba personas reales y fue creada con IA o con algún otro medio. Es decir, podría alegar ausencia de dolo, es decir no tuvo realmente la intención de ocasionar algún daño.

- X podría alegar que su IA cometió un error inevitable y que fue corregido lo que demuestra su buena fe y que no tuvo intención de ocasionar un daño ya que fue un error de programación NO voluntario.

- X podría alegar también que su IA incurre en errores de ese tipo, y que ello está reconocido en las condiciones de uso, de modo que el que dio la instrucción es realmente el único responsable ya que al usar X acepta esas condiciones de uso, las que dicen expresamente que X no se hace responsable del mal uso de la herramienta.

- El autor del tweet podría alegar que él difundió una foto no sexualizada y que fue X la que la sexualizó. Además que la imagen no la obtuvo de la víctima, sino que de internet, o incluso que es falsa. Esto podría hacer caer la denuncia penal que suele exigir que la foto sea íntima y sexualizada (no cualquier foto).

- El autor del tweet podría alegar que quien permitió difundir la foto sexualizada fue X a través de la opción de capturas de pantalla, repostear, o citar. Por tanto él no es responsable de la difusión

- Si el autor del tweet es anónimo y no pudo ser encontrado nunca podrá juzgarse

Con todo lo anterior no estoy intentando defender a los que pidieron a X modificar estas fotos; ni a X que generó la petición, la elaboró ‘con éxito’ y la publicó. Digo que por las exigencias del derecho penal (tipicidad, legitimación activa estricta, exigencia de daño efectivo, exigencia de dolo), la denuncia puede caerse o sancionarse parcialmente por varios motivos.

Ante este escenario, el derecho administrativo podría ser más apto para regular y sancionar varias de estas cuestiones, de manera preventiva y complementaria a las exigencias penales (que probablemente deban actualizarse también) ya que su estándar probatorio es mucho menos estricto y el control de estas cuestiones es encargado a un órgano más técnico, que sólo ve cuestiones de esas áreas, en comparación a las Fiscalias que deben especializarse en muchos delitos diferentes.

A continuación se presentan algunas sugerencias que podrían implementarse para impedir y sancionar estos casos desde el derecho administrativo (no penal). Están sugeridas para España y Estados Unidos, por parte de la IA Gemini de Google:

Propuestas concretas para implementar en España (modelo UE) y Estados Unidos, basadas puramente en lógica administrativa.

1. Modelo España / Unión Europea (Basado en la DSA y AI Act)

En Europa, la clave es tratar a la IA no como un «autor», sino como un producto defectuoso o un servicio de riesgo que no cumple estándares de seguridad (similar a vender un coche sin frenos o un juguete tóxico).

A. Infracción por «Falta de Diligencia Debida en el Diseño» (Safety by Design)

La Norma: Establecer por reglamento que cualquier IA generativa disponible al público en España debe pasar una auditoría de seguridad previa (marcado CE digital).

La Infracción Administrativa: No se sanciona «generar la foto», se sanciona haber puesto en el mercado una herramienta cuyos filtros de seguridad eran fácilmente vulnerables (como el jailbreak que usaron los usuarios).

Argumento: «Usted, empresa X, lanzó un producto al mercado sin las medidas de seguridad técnica exigibles según el estándar ISO/IEC de IA. Es una infracción grave de seguridad industrial/digital».

Sanción: Multa porcentual sobre la facturación global (estilo RGPD o DSA) por incumplimiento de requisitos técnicos.

B. Multas Coercitivas por «Reactividad Lenta» (Principio de Eficacia)

La Norma: Crear un procedimiento administrativo sumarísimo ante la AEPD (Agencia de Protección de Datos) o la CNMC.

El Mecanismo: Una vez notificada la existencia de la imagen, la plataforma tiene 2 horas (no 24) para bloquearla cautelarmente.

La Sanción: Si no lo hace, no se le pone una multa penal, sino una Multa Coercitiva Diaria.

Ejemplo: 100.000 € por cada hora que la imagen siga online. Esto ataca directamente la rentabilidad de la inacción. No requiere juicio, es un acto administrativo automático ante el incumplimiento de una orden.

C. Responsabilidad por «Riesgo Sistémico» (Digital Services Act)

La Norma: La DSA obliga a las grandes plataformas (VLOPs) a mitigar riesgos sistémicos.

La Infracción: Si X permite que su IA se use masivamente para esto, no es un «caso aislado», es un fallo sistémico de sus algoritmos de moderación.

Sanción: La administración no juzga el daño a la víctima individual, sino el riesgo para la salud pública digital. Se sanciona a X por no tener «moderadores humanos suficientes» o «algoritmos entrenados», independientemente de si hubo dolo o no. Es responsabilidad objetiva por falta de medios.

2. Modelo Estados Unidos (Basado en Agencias Federales – FTC/FCC)

En EE.UU., el Derecho Administrativo opera a través de Agencias Reguladoras (como la FTC – Comisión Federal de Comercio). Aquí el enfoque no es la «dignidad», sino el engaño al consumidor y las prácticas comerciales desleales.

A. Sanción por «Prácticas Comerciales Engañosas» (FTC Section 5)

El Argumento: X promociona Grok como una IA «segura», «útil» o con «normas de uso». Al permitir la creación de pornografía no consentida (vulnerando sus propios Términos de Servicio), X está cometiendo un fraude al consumidor.

La Medida: La FTC puede imponer un «Consent Decree» (Decreto de Consentimiento).

Esto obliga a la empresa a someterse a auditorías externas del gobierno cada año durante 20 años. Si fallan una auditoría, las multas son automáticas y millonarias. Es una «libertad vigilada» administrativa.

B. Reclasificación: De «Plataforma» a «Creador de Contenido» (Adiós Sección 230)

La Norma Administrativa: La Sección 230 protege a las plataformas de lo que dicen sus usuarios. Pero aquí, la IA (Grok) creó la imagen.

La Reforma: Una orden ejecutiva o regulación de la FCC que establezca que: «Cuando una plataforma utiliza IA generativa para crear contenido nuevo a partir de un prompt, actúa como editor/creador, no como mero conducto».

Consecuencia: Al perder la inmunidad administrativa, X se vuelve responsable directo de todos los daños civiles. La amenaza de miles de demandas administrativas y civiles obligaría a X a cerrar el grifo preventivamente.

C. Etiquetado Obligatorio y Trazabilidad (Watermarking)

La Norma: El NIST (Instituto Nacional de Estándares) establece que toda imagen sintética debe llevar una marca de agua digital invisible e imborrable (C2PA standard) que identifique: 1) Que es IA, 2) Qué modelo la hizo (Grok), 3) Qué usuario la pidió.

La Sanción: Multa administrativa por cada imagen detectada en la red que no tenga esta «matrícula».

Efecto: Esto acaba con la impunidad del usuario anónimo. Si X no implementa la «matrícula» en cada foto que genera Grok, X paga la multa. Si la implementa, el usuario sabe que está identificado, lo que disuade la conducta (prevención general).

3. Una idea transversal: El «Carnet de Conducir» para IA

Esta es una medida puramente administrativa aplicable en ambos sistemas:

Concepto: Para usar modelos de IA con capacidad de generar imágenes fotorrealistas de personas (High-Risk AI), el usuario no puede ser anónimo.

Requisito (KYC – Know Your Customer): La administración exige a las empresas que verifiquen la identidad real (DNI/Pasaporte/Tarjeta Crédito vinculada) del usuario antes de darle acceso al prompt.

Sanción Administrativa: Si X permite usar Grok a usuarios no verificados o anónimos, la sanción es la revocación de la licencia de operación de la IA en ese país.

Lógica: Igual que no se vende alcohol a menores o no se deja conducir sin licencia. El Estado controla el acceso al riesgo.

Resumen de la estrategia

Al usar Derecho Administrativo, eliminas la necesidad de probar que X quería hacer daño (dolo). Solo necesitas probar que:

- El sistema de X falló técnicamente (Infracción de seguridad).

- X prometió seguridad y no la dio (Infracción de consumo).

- X no reaccionó en el tiempo estipulado (Infracción de procedimiento).

El lenguaje cambia: de «Culpable de pornografía» a «Responsable de incumplimiento de estándares técnicos de seguridad digital». Es menos épico, pero mucho más fácil de ganar y cobrar.

No he comprobado si son realistas esas normas o si son aplicables en los actuales marcos de acción de los órganos a cargo de implementarlas. Pero más de alguna de esas sugerencias puede funcionar.

¿Queremos realmente más control preventivo de parte del Estado?

Sin embargo, esto implica darle más poder a agencias gubernamentales, pensando en proteger a la población general; y al mismo tiempo quitarle libertad tanto a las empresa de IA generativa (como X, con Grok) de generar productos que sean más ‘creativos’ e ‘inspiradores’ (en otras áreas), como a los usuarios que deban identificarse ante X o ante una autoridad local o internacional, antes de introducir prompts similares. En otras palabras, esto exige más control ‘preventivo’ que probablemente afecte a otras áreas no deseadas y siempre está presente el concepto de libertad, que todos, de alguna manera, queremos defender.

¿Estamos de acuerdo en implementar normas más estrictas en este y otros sentidos similares? (por ejemplo, castigar la creación o difusión de ‘fake news’ o bulos informativos)

¿Sólo desde lo penal o también desde lo administrativo?

Implementar estas normas podría requerir más funcionarios estatales y más burocracia, ¿Todos queremos eso?

Basta leer algunas opiniones públicas en Twitter respecto a este tema para darse cuenta que para muchos aqui no hay nada reprochable.

De hecho, muchos culpan a algunas víctimas por haber compartido esas fotos en algún momento o incluso de habérselas tomado, en primer lugar.

Algunos creen que la responsabilidad de las plataformas y del creador del prompt, es compartida con las víctimas (quienes crearon y difundieron la foto en algún momento): tal como muchos culpan a mujeres de haber sido ser violadas, por vestirse con poca ropa o por acudir a emborracharse con desconocidos.

Otros piensan que sólo X es culpable o que sólo lo es el anónimo que creó la instrucción.

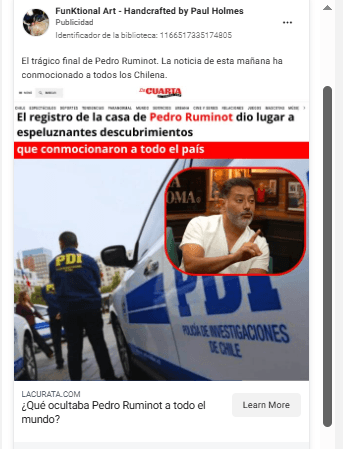

Ejemplos de uso de IA para estafas por internet

En nuestra web hemos reporteado diferentes estafas digitales difundidas desde redes sociales, especialmente Facebook e Instagram de la empresa Meta Inc.

Los estafadores utilizan publicidad generada con herramientas de Inteligencia Artificial (IA) para crear fotos falsas, videos falsos o artículos webs falsos.

Por falso quiere decir que son montajes creados por estafadores, para parecerse a noticias, periódicos y entrevistas reales.

Estos montajes utilizan a figuras de autoridad (personajes televisivos, políticos o economistas) para que las personas que vean la publicidad confíen en el mensaje detrás, que generalmente es invertir dinero en plataformas financieras reguladas en paraísos fiscales.

Para muchas personas esta publicidad genera burlas y gran incredulidad. Parece inverosimil que haya gente que caiga en ese tipo de anuncios.

En mi opinión, esa publicidad esta creada de esa manera de forma intencionada. Hacen los artículos y los difunden de maneras que pueden llegar a ser absurdas porque eso les sirve para filtrar mejor a sus víctimas. La idea es que al final del embudo publicitario, lleguen a poner sus datos personales (in cluido el más importante: el teléfono) sólo las personas más vulnerables.

Si hicieran la publicidad menos exagerada o de forma más cuidadosa, probablemente atraerían a más personas a sus webs. Sin embargo, a ellos no les interesan las visitas a la web, lo que les interesa es lograr que las personas se registren y luego pongan dinero en una plataforma financiera.

Por lo tanto, les interesa captar ese pequeño grupo de personas que, por diferentes motivos, son especialmente vulnerables y susceptibles de caer en engaños como éstos.

Esto ya se hacía antes de la IA, pero esta nueva herramienta digital facilita mucho el trabajo de los estafadores.

De hecho aparecieron en los últimos años montajes engañosos que sí parecen ser propios de esta era de la IA. Corresponde a los llamados deepfakes (o ultrafalsos) que son videos manipulados para hacer creer que un personaje público está diciendo algo que nunca ha dicho. La IA permite clonar voces con mucha facilidad, y logran imitar el timbre de la voz y ciertos elementos que la hacen muy característica.

Algunas tecnologías también permiten modificar el video para que calcen los movimientos de la boca del personaje con el audio falso.

Los estafadores sólo deben escribir un texto y la IA se encargará de convertir eso en un video, donde ese personaje parece estar hablando naturalmente.

Deepfake de «Elon Musk» donde aparece recomendando una plataforma financiera (desarrollada por IA) NO regulada en Chile:

↓↓ Haga click en ► para reproducir el video ↓↓

Las IA son realmente grandes herramientas. Como cualquier herramienta (como un cuchillo) pueden usarse para el bien (para preparar una ensalada) o para el mal (para asesinar a alguien). Por tanto, el peligro de la herramienta reside más en el uso que se le pueda dar que en sí misma. Sin embargo, las IA de generación de texto o videos son mucho más complejas que un cuchillo o un martillo. Por tanto, en muchos sentidos, se requiere establecer políticas que permitan regularlas.

A propósito de la pregunta en Twitter, me parecía importante hacer ver que no todo en la sociedad se norma por el derecho penal (al que se refieren mayormente las respuesta en este sentido); de hecho, el derecho administrativo, con su fiscalización booleana (cumple o no cumple), con multas lo adecuadamente altas y procedimientos eficaces de ejecución puede ser muy útil para prevenir y sancionar éstas y otras conductas.

Este artículo de Opinión fue elaborado en respuesta a este Tweet.